가장 먼저 서빙할 모델을 준비해놓기 위해 작년 1년 동안 RoBERTa 모델 학습+실험을 해오면서 가장 성능이 괜찮게 나왔던 '순서 랜덤 셔플+한꺼번에 학습(continuous learning X)'대로 순백의 roberta-base base 모델에 파인튜닝을 다시 했다.

학습 데이터는 제일 신문사/뉴스 주제(스포츠, 정치, 시사 등등)/문장 스타일이 다양한 문장들이 셔플되어 있는 학습 데이터로 선택했다. 약 15만 개, true-false 문장이 8만 쌍 가까이 있는 데이터다. ('final'이란 단어까지 들어가 진짜 최종 데이터라는 데이터팀의 의지가 여실히 드러나는 이름ㅋㅋ)

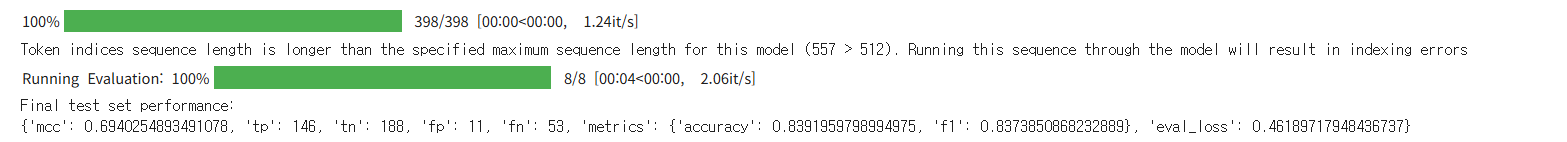

epoch은 그대로 3으로 학습. CPU로 돌려서 그런지 총 4시간 정도 걸렸다.

학습 완료 후의 test set performance. Accuracy는 약 0.84 정도다.

먼저 열심히 학습시킨 모델 서빙을 위해 모델 가중치와 토크나이저 관련 파일을 Colab에서 다운로드 했다. 학습에만 필요했던 옵티마이저, 스케줄러 파일은 제외했다. 서빙에 필요한 파일/필요없는 파일은 아래와 같다.

| model.safetensors | 학습된 가중치 (핵심!) | ✅ |

| config.json | 모델 구조 정의 | ✅ |

| tokenizer.json | 토크나이저 설정 | ✅ |

| tokenizer_config.json | 토크나이저 설정 | ✅ |

| special_tokens_map.json | 특수 토큰 정의 | ✅ |

| vocab.json | 단어 사전 | ✅ |

| merges.txt | BPE 병합 규칙 | ✅ |

| optimizer.pt | 옵티마이저 상태 (학습용) | ❌ |

| scheduler.pt | 스케줄러 상태 (학습용) | ❌ |

| training_args.bin | 학습 설정값 | ❌ |

그 뒤로는 학습 시 설정한 레이블이 뭔지 다시 한 번 확인했다. Binary classification 모델이므로 0과 1로 레이블된 바가 바뀌면 AI-generated <-> Human-generated가 거꾸로 나오는 참사가 일어난다... 이 프로젝트에서는 0=사람 작성, 1=AI 생성으로 설정했다.

이제 위의 표시되어 있는 파일들을 backend\model_files 경로에 넣어주면 모델 파트는 끝!

'My > 로식이 집 만들기 프로젝트' 카테고리의 다른 글

| 0. 개요 (0) | 2026.03.22 |

|---|